Creen un ‘verí' que intoxica les IA generatives entrenades amb imatges protegides

Nighshade introdueix uns píxels invisibles a les obres d’artistes que confón la interpretació dels models i els condueix a produir resultats incorrectes

Categories:

L’auge dels models generatius d’imatges basats en intel·ligència artificial, com DALL·E, Midjourney o Stable Diffusion, preocupa des de fa temps els artistes digitals, que han vist com moltes d’aquestes eines utilitzaven obres seves per entrenar els algoritmes sense permís exprés. Amb la intenció de dotar-los una eina per contrarestar aquesta tendència, un grup d’investigadors de la Universitat de Chicago està desenvolupant Nightshade, una eina de codi obert destinada als artistes creada per ‘enverinar’ els models generatius i empitjorar-ne l’ús.

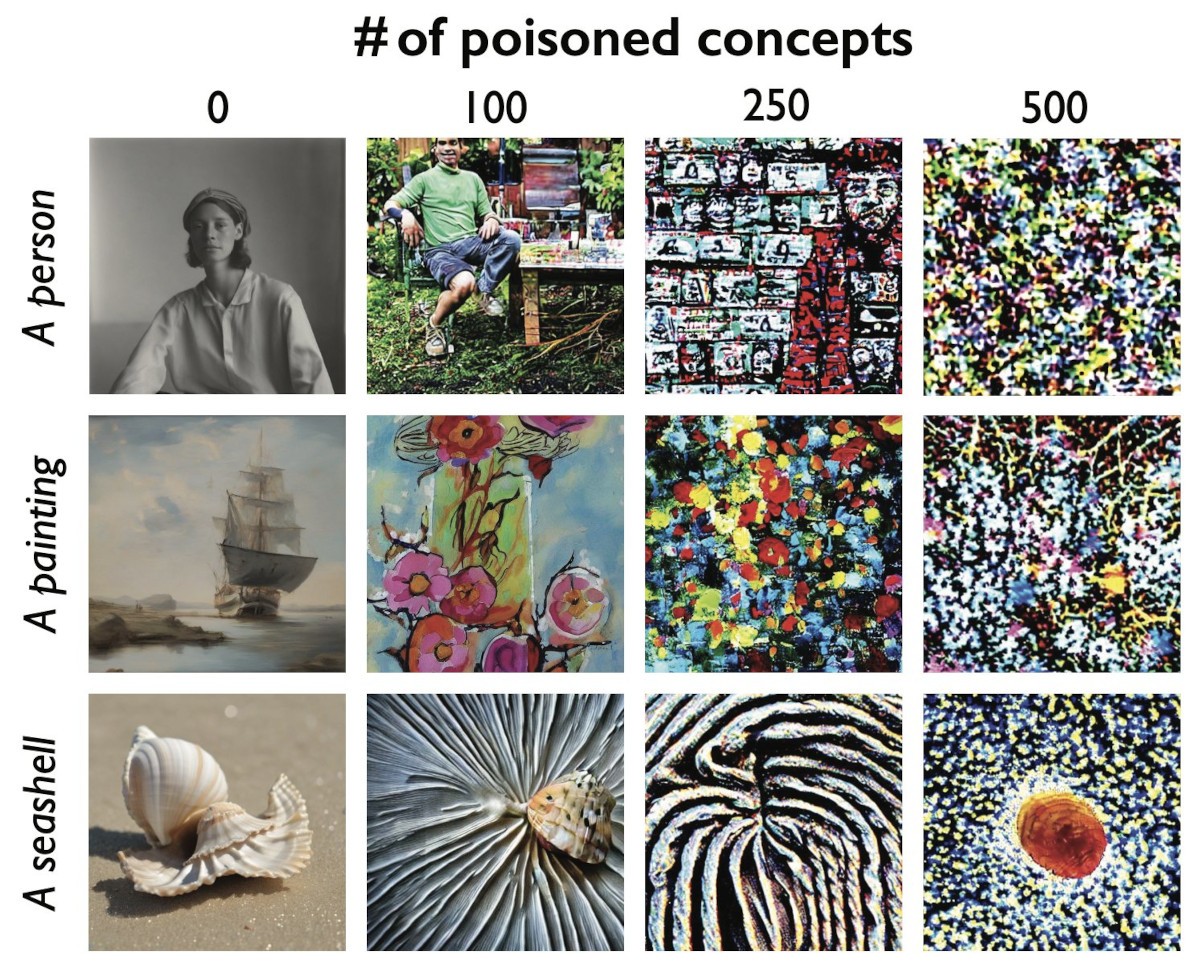

El programari està pensat per aquells il·lustradors i altres creadors digitals que vulguin compartir les seves obres a les xarxes sense que aquestes s’usin per entrenar models d’IA. El que fa l’eina és introduir una sèrie de canvis en els píxels de les imatges, que són imperceptibles per l’ull humà, però que provoquen comportaments imprevistos i caòtics en els models. Aquestes modificacions provoquen que els algoritmes identifiquin els elements de les imatges com coses que no són: pastissos en comptes de barrets, gossos en comptes de gats… Les proves fetes per l’equip, en un model d’elaboració pròpia i també a Stable Diffusion, corroboren que amb la introducció d’unes 300 imatges de gossos intoxicades amb aquest programari, el model generatiu ja comença a tenir problemes per crear imatges d’aquests animals.

Un dels factors clau d’aquesta eina és que és molt fàcil provocar problemes, però, en canvi, és molt complicat que les companyies siguin capaces de localitzar-ne l’origen, ja que els models estan entrenats amb milions d’imatges. El líder de l’equip darrere de Nightshade, Ben Zhao, explica al digital MIT Technology Review que han decidit impulsar aquesta eina amb l’esperança d’anivellar la “balança de poder” entre les companyies especialitzades en IA i els artistes, així com protegir la seva propietat intel·lectual.

De fet, Nightshade no és la primera eina en aquesta línia que desenvolupa l’equip liderat per Zhao. Els investigadors són també autors de Glaze, un programari que fa servir una tècnica similar per incorporar una capa de protecció invisible a les obres dels artistes, de manera que els models generatius no siguin capaços d’identificar correctament a quin estil artístic pertanyen les creacions i, així, sigui molt més complicat que copiïn o reprodueixin el seu art. La intenció dels creadors és integrar els serveis de Nighshade dins de l’aplicació de Glaze, de manera que els artistes, quan protegeixin la seva obra, puguin escollir si també volen incorporar el ‘verí’ per afectar els models generatius.